El evento Google I/O, en el que el gigante tecnológico presenta todas las novedades para desarrolladores interesados en su ecosistema de servicios, comenzó con su edición anual este martes y se extenderá hasta el 20 de mayo, en formato 100% virtual.

La transmisión en directo comenzó con la presentación de unos personajes animados bautizados como "The Blobs", creados a partir de un algoritmo que los desarrolla para que canten con estilo de ópera.

Estos personajes fueron creado por David Li en colaboración con el equipo de Arte y Cultura de Google, y dan cuenta de cómo se puede aprovechar el aprendizaje automático para crear algo diferente a partir de datos existentes.

Tras la previa musical, el CEO de Google Sundar Pichai apareció en escena y comenzó con un discurso sobre la difícil situación que atraviesan diferentes países del mundo por la pandemia de covid-19, como su India natal. Desde la web o el móvil, sus colaboradores pueden revisar las reuniones y personas asociadas u obtener una vista previa de los documentos vinculados, todo sin cambiar pestañas o contextos. También se anunció Tensor Processing Unit v4 o TPU v4, que ofrece mayor capacidad computacional y está orientada a los centros de datos de la compañía. Este sistema se diferencia porque no solo comprende, sino que también genera lenguaje. Está capacitado en 75 idiomas y es capaz de realizar muchas tareas diferentes a la vez, lo cual le brinda una comprensión más completa de la información y el conocimiento del mundo que los modelos anteriores. Además, al ser multimodal, comprende la información en texto e imágenes y, en el futuro, puede expandirse a más modalidades como video y audio. Además, se sumarán señales de tráfico nuevas y útiles para intersecciones complejas para que el usuario sepa exactamente en qué calle se encuentra y qué camino debe tomar, como así también indicaciones en espacios interiores como galerías comerciales o el metro.

En ese sentido, Pichai resaltó que la compañía incorporó nuevos elementos en el buscador para optimizar la disponibilidad de información vinculada con esta temática, como por ejemplo la posibilidad de conocer dónde se encuentran los centros de vacunación cercanos al usuario.Smart Canvas

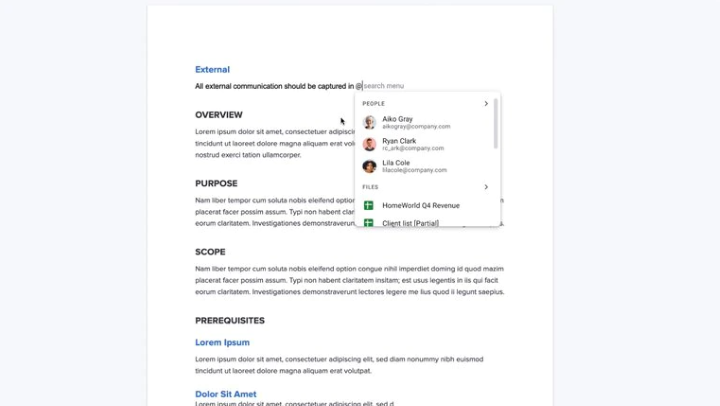

La incorporación de una suerte de lienzos inteligentes en Google Worskpace está pensada para favorecer el trabajo colaborativo remoto.

Como se sabe, cuando se arroba a una persona en un documento, una etiqueta inteligente muestra información adicional de ese usuario como su ubicación, el cargo y la información de contacto.

La novedad de Smart Canvas es que a partir de ahora esta opción estará disponible en Documentos para reuniones y archivos recomendados, que se mostrarán de igual manera en una lista al escribir "@".

Además, Smart Canvas ya permite crear tareas compartidas entre todos los miembros de un equipo de trabajo, mejorando la colaboración mediante la suite de aplicaciones de Google.

A su vez, con el nuevo formato sin páginas en Documentos, se podrán eliminar los límites de una página para crear una superficie que se expanda a cualquier dispositivo o pantalla que se esté usando, lo cual facilita el trabajo con tablas anchas, imágenes grandes o detalladas en los comentarios.Google Meet

A partir de este martes, se implementará la capacidad de presentar el contenido en una llamada de Google Meet en la web directamente desde el documento, la hoja o la diapositiva donde se esté trabajando.

El próximo paso es llevar Meet directamente a Documentos, Hojas de cálculo y Presentaciones en la Web, para que las personas puedan verse y escucharse entre sí mientras trabajan de forma colaborativa.

También se irán sumando nuevos idiomas a los cinco que ya están incluidos dentro de la opción de subtítulos en vivo para videollamadas.Inteligencia artificial capaz dialogar como un humano

También se presentó LaMDA, por las siglas de "Modelo de lenguaje para aplicaciones de diálogo", el cual es capaz de entender de forma más precisa las conversaciones y le permite al sistema participar de intercambios más fluidos que van moviéndose a lo largo de una variedad de temáticas y categorías.

Al igual que otros modelos de lenguaje como BERT y GPT-3, LaMDA se basa en Transformer, una arquitectura de red neuronal de cógido abierto creada por Google Research capaz de predecir términos mediante la lectura de muchas palabras, la relación entre ellas y el contexto del diálogo.

Privacidad y seguridad

Jen Fitzpatrick, vicepresidenta senior de Google, subió al escenario para hablar sobre las medidas de seguridad y privacidad que implementa la empresa y remarcó que los productos son seguros por default, asegurando que uno de los grandes problemas que tienen los usuarios es el empleo de claves inseguras.

Para mejorar esto se anunció una nueva interfaz para el gestor de contraseñas de Google y alertas para claves vulneradas. También habrá un borrado automático de la actividad de cuentas con más de 18 meses de antigüedad, una mejor integración entre Android y Chrome y recordatorios periódicos de Google Maps para avisar al usuario cuando tenga activado el historial de ubicaciones. Nuevo modelo de IA para el buscador

Tras el lanzamiento de BERT en 2019, Google presentó este martes un nuevo modelo unificado de multitarea bautizado como MUM, el cual viene a mejorar la comprensión del lenguaje.

MUM es 1.000 veces más poderoso que BERT y puede realizar múltiples tareas para obtener información de nuevas formas, aseguró el vicepresidente senior de Google Prabhakar Raghavan.

Realidad aumentada para Google Maps

Desde Google anunciaron algunas novedades interesantes para Maps con el objetivo de mejorar la circulación en auto y a pie, y la primera tiene que ver con una actualización para evitar congestiones de tránsito y frenadas bruscas.

"Creemos que estos cambios tienen el potencial de eliminar 100 millones de eventos de frenado brusco en las rutas conducidas con Google Maps cada año", destacaron desde la compañía.

Otro anuncio estuvo vinculado con el uso de realidad aumentada para conocer más detalles sobre las tiendas y restaurantes que nos rodean, una herramienta que mostrará detalles útiles sobre las tiendas y restaurantes de los alrededores de nuestra ubicación actual, como el nivel de ocupación, reseñas recientes y fotos.

Todas estas características comenzarán a implementarse a nivel mundial en Android e iOS durante los próximos meses, y la función con mapas de calles detallados llegarán a 50 nuevas ciudades para fin de año.