“Creo que alcanzamos la inteligencia artificial general”, planteó Jensen Huang, CEO de Nvidia y una de las figuras más influyentes del negocio de la inteligencia artificial, el pasado lunes 23 de marzo, durante una charla en el podcast del investigador del MIT Lex Fridman. La frase, casi deslizada en medio de una conversación en la que se hablaba del presente de la industria y la velocidad de los avances, golpeó como una bomba y fue levantada de inmediato por la prensa, ocupando los principales titulares en todo el mundo.

El efecto en los mercados fue inmediato. Los inversores interpretaron que si la AGI (inteligencia artificial general, por sus siglas en inglés) ya estaba entre nosotros, la necesidad de chips no tendría techo en el corto plazo, por lo que las palabras de Huang se leyeron como una señal de compra. Tras la publicación de la entrevista, las acciones de Nvidia subieron un 1,7% y quedaron operando en el rango de los USD 176-180. Para una empresa valorada en 4,3 millones de millones de dólares, significa que su valor aumentó unos 70.000 millones en un solo día, un volumen enorme solo por una declaración dicha al pasar.

Nvidia es la empresa más valiosa del mundo como resultado de una estrategia definida hace veinte años, cuando lanzó CUDA, una plataforma de software que permitió que sus tarjetas gráficas hicieran mucho más que renderizar videojuegos en la pantalla de una computadora. Este ecosistema se volvió indispensable para cualquier investigador de inteligencia artificial mucho tiempo antes del furor actual por la IA generativa.

Durante años, los inversores criticaron a Huang por gastar millones en esto cuando "nadie lo usaba", pero cuando explotó el Deep Learning en 2012, Nvidia era la única que tenía el hardware y el software listos. Hoy, la empresa controla casi 95% del mercado de chips para entrenamiento de grandes modelos de lenguaje, como ChatGPT, Claude o Gemini, lo que la coloca en el centro de toda la infraestructura sobre la que hoy se construye la inteligencia artificial.

Esta posición de dominio total y absoluto sobre el negocio le permite a Huang fijar las reglas del juego incluso antes de que comience el partido. Sin embargo, la afirmación de que la AGI ya fue alcanzada está lejos de ser un consenso dentro de la comunidad científica, ya que este es, probablemente, el concepto más difuso y discutido de la industria tecnológica actual. En lo único que hay cierto nivel de acuerdo es en que la AGI debería ser una inteligencia artificial capaz de hacer cualquier tarea intelectual que pueda hacer un ser humano, al menos con el mismo rendimiento. Si algún día aparece, tendría que ser capaz de aprender una tarea nueva sin haber visto ejemplos previos y, entre muchas otras cosas sorprendentes, mejorarse a sí misma de manera autónoma.

Hoy, ningún sistema cumple todo eso, y en el último tiempo los líderes tecnológicos le fueron dando forma a diferentes conceptos basados en sus prioridades o en sus intereses particulares, dando lugar a definiciones que no siempre son comparables entre sí. Google DeepMind, por ejemplo, propone una visión más gradual y científica, en la que la AGI no es un punto de llegada sino una escalera de capacidades cuyo valor está en descubrir conocimientos que todavía no alcanzamos. OpenAI, en cambio, adopta una mirada más pragmática, donde la AGI se mide por su impacto económico y su capacidad de reemplazar trabajo humano, más que por cómo razona o entiende el mundo.

La visión de Huang, sin embargo, no apunta a una inteligencia artificial que piense como un humano, sino a algo mucho más práctico y tangible. En la conversación con Lex Fridman, el CEO de Nvidia vinculó la idea de AGI con la expansión de agentes capaces de ejecutar tareas por cuenta propia, desde gestionar proyectos hasta crear productos digitales o incluso construir negocios completos. En ese escenario, la inteligencia no se mide tanto por su profundidad conceptual, sino por su capacidad de hacer cosas útiles en el mundo real, incluso eventualmente generar ingresos. No importa la discusión filosófica sobre si piensa o no, lo que importa es lo que produce. Y es bajo esa vara donde Huang responde que la AGI ya es una realidad.

De hecho, tras la frase que encendió la polémica, el propio Huang bajó el tono. Reconoció que, al menos actualmente, muchos de estos agentes tienen un comportamiento imprevisible y que la probabilidad de que no uno, sino cien mil de ellos construya una empresa como Nvidia es, según sus propias palabras, “cero por ciento”. Ahí aparece el verdadero núcleo del problema. Entre los agentes que hoy pueden ejecutar tareas específicas con cierta autonomía y un sistema capaz de crear y sostener una empresa multimillonaria hay una distancia enorme, distancia que el propio Huang reconoce cuando descarta, al menos por ahora, que algo así sea posible.

Frente a esta discusión, algunos referentes del sector intentan bajar el debate a un terreno más concreto. Uno de ellos es Demis Hassabis, cofundador de Google DeepMind y una de las mentes más respetadas en la arquitectura de redes neuronales. En febrero de este año, durante la India AI Impact Summit, propuso lo que ya se conoce como el “Test de Einstein”, una forma simple pero extremadamente exigente de medir si una inteligencia artificial puede considerarse realmente general.

El experimento consiste en suministrar a una IA únicamente el conocimiento científico que estaba disponible hasta el año 1911 y evaluar si, de manera totalmente autónoma, el sistema es capaz de deducir la teoría de la Relatividad General tal como hizo Albert Einstein en el año 1915. Este test es fundamental en el debate actual sobre la AGI porque demuestra que, aunque modelos de 2026 como Gemini 3.1 Pro o GPT-5 pueden superar exámenes de nivel de doctorado con picos de rendimiento sobrehumano, todavía fracasan estrepitosamente al intentar crear ciencia desde cero. El día que puedan dar ese salto más allá de los límites del conocimiento, tendremos verdadera inteligencia artificial general.

Sin embargo, Hassabis, quien ganó el Premio Nobel de Química en 2024 por el desarrollo de AlphaFold, un sistema de IA capaz de predecir la estructura tridimensional de las proteínas a partir de su secuencia genética, es optimista. Para él, todavía faltan uno o dos avances clave para lograr una verdadera AGI, pero considera que en este momento estamos en un punto crítico, en el que la inteligencia artificial general está a punto de llegar quizá dentro de los próximos cuatro o cinco años.

El contraste entre Huang y Hassabis no es solo una cuestión de palabras, sino que refleja dos formas distintas de entender qué cuenta como inteligencia, ya sea generando valor real económico o científico. De cualquier manera, Nvidia gana en ambos escenarios. Si Huang tiene razón, la demanda de GPUs y clústeres de IA se disparará. Si, por el contrario, Hassabis está en lo cierto y aún faltan algunos avances, igual se necesitará una infraestructura computacional cada vez más grande para entrenar y ejecutar esos sistemas del futuro.

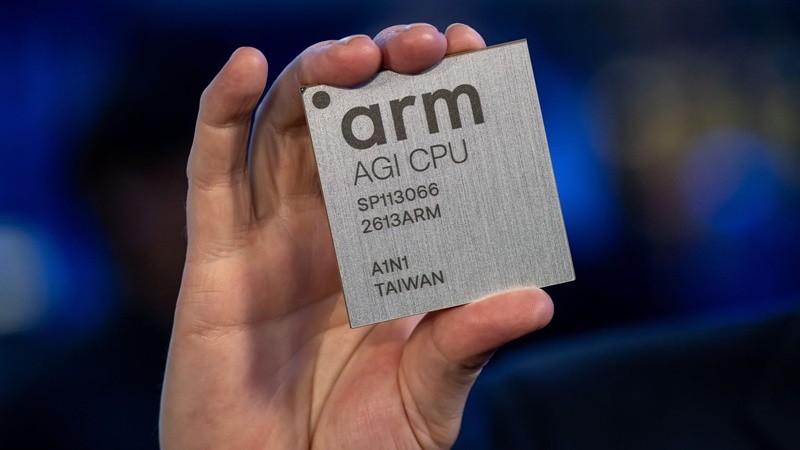

Esta semana, la carrera por adueñarse del concepto se profundizó aún más. Por un lado, OpenAI renombró su división de producto como AGI Deployment (Despliegue de AGI) y Sam Altman anticipó que el próximo gran modelo, aún sin nombre oficial confirmado y que estaría a punto de lanzarse, será capaz de “acelerar realmente la economía”. Por otro, la empresa británica ARM presentó un procesador para centro de datos al que directamente bautizó AGI CPU, un chip diseñado en colaboración con Meta para gestionar sistemas de inteligencia artificial agéntica a gran escala.

Si la AGI es una meta lejana o un movimiento de marketing para sostener valuaciones multimillonarias es, por ahora, secundario. Lo que sí está claro es que la AGI no necesita existir del todo para transformar el mundo. El debate en sí mismo ya alcanza para mover mercados, adelantar inversiones y tomar decisiones como pocas veces se ha visto en la historia de la tecnología. Todo montado sobre la base de un concepto que todavía nadie sabe exactamente cómo definir.